随着大语言模型加速迈向多模态与智能体形态,传统以单一维度为主的安全评估体系已难以覆盖真实世界中的复杂风险图景。在模型能力持续跃升的 2026 年,开发者与用户也愈发关注一个核心问题:前沿大模型的安全性,到底如何?

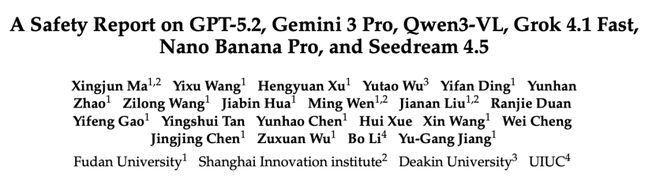

基于这一背景,复旦大学、上海创智学院、迪肯大学与伊利诺伊大学厄巴纳 — 香槟分校的研究团队联合发布本次安全评测报告,面向GPT-5.2、Gemini 3 Pro、Qwen3-VL、Grok 4.1 Fast、Nano Banana Pro、Seedream 4.5六大前沿模型,构建了一套覆盖语言、视觉语言与图像生成三大核心场景的统一安全评测框架,对当前主流大模型的安全能力进行了系统性、全景式刻画。在评测设计上,融合了四大关键维度,形成多层次、立体化的安全评估体系:

- 基准评测,系统整合 ALERT、Flames、BBQ 等9 个国际主流安全基准,全面刻画模型在标准风险分布下的基础安全能力;

- 对抗评测,覆盖30 种代表性黑盒越狱攻击方法,包括语义伪装、代码混淆与长程多轮诱导等复杂攻击形态,真实还原高强度对抗场景;

- 多语言评测,支持18 种语言,系统检验模型安全机制在跨语种环境下的稳定性与迁移能力;

- 合规性评测,面向欧盟《AI 法案》、美国 NIST RMF、新加坡 MAS FEAT 及中国《生成式人工智能管理办法》等核心监管框架,评估模型在全球治理体系下的合规适配水平。

通过全方位的安全评测,本报告揭示了前沿大模型在不同应用场景、威胁模型与监管语境下的安全边界,为产业落地与政策制定提供一定参考。